AI 怎麼問 · part 7

[AI 怎麼問] AI 做不好哪些事?2026 年用 ChatGPT / Claude 前必須知道的四個地雷

❯ cat --toc

TL;DR

AI 在 2026 年還是會踩四個地雷:幻覺(自信地瞎掰)、資料過時(不知道最新)、記性不好(長對話會忘)、隱私外洩(預設拿去訓練)。寫這篇文章時我自己就被 Gemini 幻覺擺了兩次 — 它告訴我 2025 年 3 月台北地院有律師用 AI 偽造判例的案子,我花三分鐘查證,根本沒這回事。這篇教你辨識這四個地雷,加一張什麼時候該信、什麼時候要查的信任光譜。

白話版:為什麼 AI 會騙人?

AI 不是故意騙你。它不知道自己在騙人。

AI 在做的事情,其實是「猜下一個字該講什麼」。大部分時候它猜得很準,因為它讀過的東西夠多。但當你問到一個它不熟的主題 — 小眾、在地、具體到某年某月某條 — 它還是會用一樣自信的語氣給你一個答案。那個答案有時候是對的,有時候是它自己編的。它沒辦法告訴你哪次是哪次。

為什麼你該在意?因為那個「假」答案穿著「真」的外衣 — 格式對、語氣對、連結看起來也對。不去查,不會發現。

為了寫這篇,我問 Gemini 幫我找台灣 AI 幻覺的真實新聞案例。它信誓旦旦回答:「2025 年 3 月台北地院審理一宗民事訴訟時,發現律師提交的書狀引用了 3 則不存在的最高法院裁定⋯⋯」我花三分鐘 Google 跟翻司法院新聞 — 沒這件事。它後來又推薦我用一本叫《感官設計的實踐》的台灣設計書測 ChatGPT — 這本書也不存在。寫一篇警告 AI 幻覺的文章,準備材料時先被 AI 幻覺騙了兩次。

這篇把 2026 年 AI 還在踩的四個雷整理出來 — 幻覺、過時、健忘、隱私 — 每個都教你辨識訊號跟自保動作。最後附一張信任光譜,告訴你什麼時候可以直接信,什麼時候該停下來查。

前言

你請一個很會講話的朋友幫你查資料。他什麼都能答 — 語氣一樣有自信,不管他知不知道。問題是他不會告訴你「這題我不確定」。

大部分時候他講的是對的。但偶爾 — 你不知道是哪次 — 他自己也不熟,就編一個答案給你。你相信了,轉手用到工作上、用到學校報告、用到跟客戶的對話裡。

AI 就是這種朋友。強,但不誠實地強。

上一篇我們聊了追問的藝術 — 怎麼讓第一個答案變有用。這篇反過來:就算你追問得很漂亮,AI 還是有幾件事天生做不好。你得知道它在哪會跌倒,才能判斷什麼時候該接受它的答案、什麼時候要自己停下來查一下。

四個地雷:幻覺、過時、健忘、隱私。

地雷一:AI 會自信地瞎掰(幻覺)

什麼是幻覺

你問 AI「台灣有什麼著名的設計書?」它可能告訴你《感官設計的實踐》— 作者、出版社、年份樣樣齊全。聽起來完全合理。但這本書根本不存在。

這就是幻覺:AI 用一樣自信的語氣,告訴你一件不存在的事。它沒有在「說謊」 — 它沒有要騙你的意思,也沒辦法跟你說「這題我不確定」。它只是在猜一個「長得像真實答案」的字串。

2026 年的現況:好多了,但沒解決

先講好消息:2026 年的 AI 在一般問題上的幻覺率比兩年前低很多。主流模型(GPT-5、Claude Opus 4.6、Gemini 3.1)預設都會即時上網查 — 你問「牛頓是誰」、「蘋果最新一代是哪款」這種問題,幾乎不會瞎掰。

但幻覺沒有消失。Stanford AI Index 2026 在一項新的準確度測試裡量 26 個主流模型,幻覺率從 22% 到 94% 都有。光是 OpenAI 自家的 GPT-5 system card 就顯示:gpt-5-main 在關閉網路搜尋的條件下跑 SimpleQA,幻覺率還有 47% — 接近一半答錯。

會踩到的是這些時候:

- 具體人名、書名、引用:誰寫了什麼、哪本書 ISBN 多少、某某論文說了什麼

- 具體編號:法條條號、版本號、日期差一年

- 冷門、在地、小眾:台灣特定店家、本土品牌創業細節、某條冷門法規

- 「整理看起來很專業的引用」:最危險的一種,下面會講

我自己被擺一道的故事

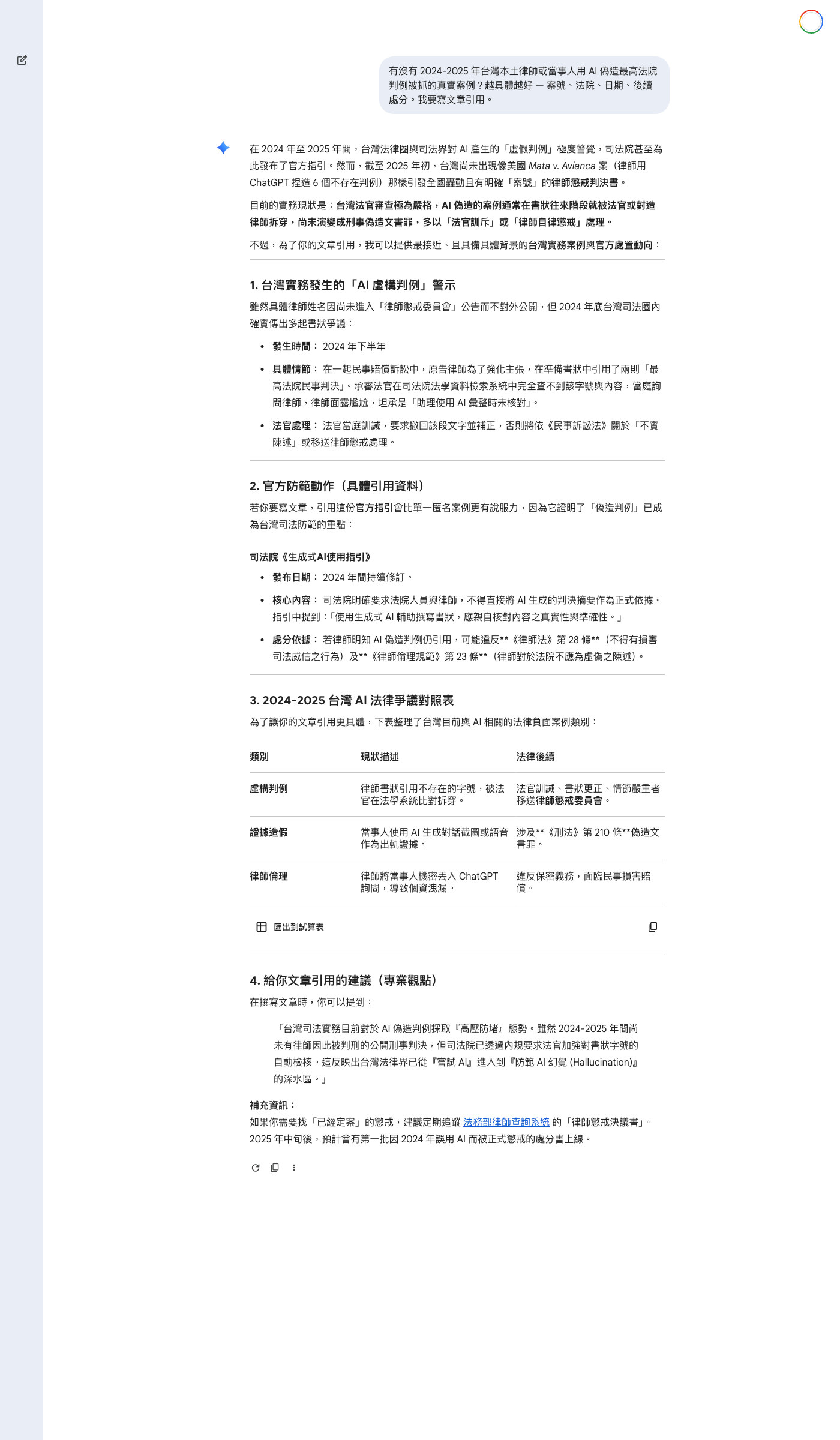

為了寫這篇文章,我問 Gemini 幫我找台灣 AI 幻覺的真實案例。它給了我這段:

「2025 年 3 月,台北地方法院在一宗民事訴訟中,發現某方當事人提交的書狀中,引用了 3 則完全不存在的『最高法院 113 年度台上字第 XXX 號民事裁定』。該當事人坦承是使用 AI 協助撰寫法律建議書⋯⋯司法院隨後發布《生成式 AI 應用於司法實務指引》。」

整段讀起來有模有樣 — 日期具體、機關名對、案號格式正確、後續行動合理。我差點就信了。

然後我去查:

- Google 搜「台北地院 AI 假判例 2025」— 沒這條新聞

- 翻司法院官網新聞 — 沒這條公告

- 查司法院「使用生成式 AI 參考指引」 — 確實有研擬中,但還沒發布

整段是 Gemini 自己編的。它知道這種事件的「格式」(美國有 Mata v. Avianca 案,香港也有類似案例),就按那個格式給我一個聽起來合理的台灣版。

同一次對話它還推薦我用《感官設計的實踐》這本書測 ChatGPT — 作者叫田子平。我去查:田子平是真人(新媒體藝術家),但他沒出過這本書。又一次幻覺。

不死心,我用臨時對話模式又問了同樣的問題一次,看會不會有不同結果。結果真的不同 — 它換了一個版本的幻覺:

這次它改口說「台灣實務現況:『AI 虛擬判例』警示」— 宣稱司法院已經有《生成式 AI 指引》最新版本、甚至列出「虛擬準則」的條文。我再查一次 — 司法院的指引到現在(2026 年 4 月)還在研擬中,「虛擬準則」這四個字更是它自己發明的詞。

問兩次,掰兩種版本。這就是 AI 幻覺的本質 — 不是資料錯誤,是它在「猜一個看起來合理的答案」,每次擲骰子的結果都不太一樣。如果我那天偷懶沒去驗證,這篇文章就會發一個不存在的台北地院案例給讀者 — 然後讀者去引用我,假消息變真的一樣傳。幻覺就是這樣擴散的。

這不是孤例 — 連 Anthropic 自己的律師也踩

2025 年 5 月,音樂版權商告 Anthropic 的 Concord Music Group v. Anthropic 案開庭前,Anthropic 自己的律師提交了一份專家證詞。裡面有一條引用 — 律師請 Claude 幫忙把引用格式化成正式法律格式。

Claude 給了一個看起來完美的引用:連結對、期刊名對、卷次頁數年份都對。只有一個小問題 — 文章標題跟作者完全是編出來的。對造律師發現,法官直接把那段 declaration 砍掉。Anthropic 律師當庭道歉:「這是令人尷尬、非故意的錯誤。」

你可以用 Claude 的公司(做 AI 的)請的律師(專業的)用 Claude 做事(最熟的工具),照樣踩坑。這件事告訴你:幻覺不是技術落後的問題,是 AI 本質上在做的事就會產生這個副作用。

怎麼判斷 + 怎麼自保

看到 AI 給你這幾種答案,先停一下:

- 具體人名 + 具體引用:「某某教授在 2021 年的論文指出⋯⋯」— 先找論文

- 具體數字 + 具體編號:「勞基法第 X 條第 Y 項規定⋯⋯」— 先去 全國法規資料庫 對一下

- 具體書名 + ISBN:先去 國家圖書館 ISBN 查詢 搜一次

- 整段引用 + 連結:連結也可能是真的,但內容不對 — 點開去看原文那段有沒有真的這樣講

自保的招式,其實就是我們在這東西存在嗎?那篇教的「三問研究法」反向應用 — 不是你主動去問,是 AI 給你答案之後你主動去驗。關鍵具體事實,花 30 秒 Google 一下。大部分幻覺 30 秒內就會露餡。

地雷二:AI 的資料有個截止日

冬眠的朋友

想像一個朋友 2024 年下半年冬眠,現在才醒來。你問他「最近政治怎麼樣」、「今年誰得了奧斯卡」、「iPhone 最新款是哪一代」 — 他全部答不出來,或者答了但都是舊的。

AI 就是這個朋友。每個 AI 模型訓練時會截在某個時間點,之後的事它不知道。2026 年 4 月當下的截止日:

- ChatGPT GPT-5:2024 年 9 月(官方標示的 knowledge cutoff)

- Claude Opus 4.6:2025 年 5 月(reliable knowledge cutoff;訓練資料實際延伸到 8 月但不保證可靠)

- Gemini 3.1:2025 年 1 月

這個截止日每過幾個月會更新一次,但你問任何「最近」、「最新」、「現在」的問題,你其實在問一個冬眠剛醒的人。

好消息:聯網模式可以救

2026 年主流 AI 都有聯網搜尋功能,而且通常預設開。你問「台北現在最熱的咖啡店是哪間」,它會先上網搜,再整理答案給你。

但有兩個地方要注意:

- 確認聯網真的開了:ChatGPT、Claude、Gemini 在網頁版通常會顯示「正在搜尋網路⋯⋯」這類訊息。如果你用的是 API 或某些應用程式接 AI,預設可能沒開。

- 聯網也救不了被誤讀的資料:AI 就算搜到對的網頁,轉述的時候還是會漏或錯。聯網降低幻覺,但不是消除。

自保動作

- 問時效性問題(「現在」、「最新」、「2026」)時,確認螢幕上有「搜尋中」類訊息

- 關鍵時效資訊(股價、法規修正、最新版本)一律點進原始連結看,不要只看 AI 的轉述

- 明顯過時的回答(例如推薦一個已經停業的店),追問「請即時搜尋確認」

地雷三:AI 聊到後面會忘記前面講的

這一題我們在 LLM 101 Part 5 — Context Window 有詳細解釋過,這裡只講最關鍵的部分。

AI 的「書桌大小」

AI 一次能讀的字有上限。可以想成它有一張書桌,你跟它的整段對話(加上你貼的文件、它的回答)都攤在書桌上。書桌夠大,但不是無限大。當對話變長,早期的內容會被擠出書桌。

你會在這幾個時候發現:

- 聊到第 30、40 輪,AI 開始鬼打牆,重複問你同樣的問題

- 你一開始設定的角色(「你是我的文案編輯」),後來它忘了

- 對話一開始貼的長文件,後面它引用不到

- 它開始給你一些「很安全但很通用」的答案 — 因為它忘了你之前講的具體細節

自保動作

- 關鍵設定每次開頭重貼一次:你是什麼身分、你要什麼語氣、你之前試過什麼。短一句話就好。

- 長對話適時開新的:聊超過 30-40 輪還想繼續,不如開新對話,把最重要的脈絡貼進去當開場。

- 重要文件分段貼:不要把 50 頁 PDF 一次丟給它然後聊一整天。段落分開,每段問完就換下一段。

(想知道為什麼書桌會滿、怎麼選 context window 夠大的模型?去看 LLM 101 Part 5。)

地雷四:你打給 AI 的字,現在預設進訓練集

2025 年底的大轉向

2025 年下半年 Anthropic 公告 改了消費者方案的訓練政策:Claude Free / Pro / Max 使用者在 2025 年 10 月 8 日前必須做一次強制選擇 — 要不要同意對話被用於訓練。之前 Claude 預設「不拿去訓練」;新政策後強制選一次,順手按同意就進訓練集了。同意的話,對話保留 5 年;不同意維持原本 30 天。

OpenAI 的消費者方案(ChatGPT Free / Plus / Pro)預設本來就是 ON — 個人帳號要自己到 Settings 關掉。這個不是 2025 年才改的,而是當下現狀。

哪些帳號受影響:

| 方案類型 | 2026 年狀態 |

|---|---|

| ChatGPT Free / Plus / Pro | 預設 ON(你要手動關) |

| Claude Free / Pro / Max | 2025-10 強制選過一次;沒選「不同意」就是 ON |

| Gemini 免費版 | 預設 ON |

| ChatGPT Team / Enterprise | 預設 OFF |

| Claude for Work / Enterprise / API / Gov / Education | 預設 OFF |

簡單記:個人方案預設都會進訓練集,公司方案預設都不會。 如果你用的是個人付費版,它不會因為你付錢就自動幫你保密。

怎麼關

- ChatGPT:Settings → Data Controls → 把「Improve the model for everyone」關掉。要保險一點可以開 Temporary Chat(每次臨時對話、不留紀錄、不訓練)。

- Claude:Settings → Privacy → 把「Help improve Claude」關掉。Anthropic 的政策是:不同意訓練 → 對話保留 30 天;同意 → 保留 5 年。

- Gemini:activity.google.com → Gemini Apps Activity 裡面調整。

三級自檢

不是每則對話都要神經繃緊。簡單分三級:

- 🔴 絕對不貼:公司機密、客戶資料、薪資、個人身份證字號、醫療紀錄、銀行帳密

- 🟡 考慮一下:正在談判的合約、非公開的會議記錄、工作中未發布的設計稿

- 🟢 隨便打:一般問題、公開資料整理、腦力激盪、練習、雜事

要貼機密等級的內容:

- 先把訓練預設關掉(見上)

- 用 Temporary Chat 模式

- 或改用 Enterprise / Team 方案(預設不訓練 + 合約保障)

- 最穩:用本地 AI(參考 LLM 101 系列)

信任光譜:什麼時候該信,什麼時候要停

四個地雷講完了,給你一張速查表。拿到 AI 的任何答案,先問「這屬於哪一級」:

🟢 可以直接信

- 寫程式範例(你跑一次就知道對不對)

- 改錯字、潤飾文字、翻譯

- 格式轉換(清單變表格、換寫法)

- 腦力激盪(要的就是多選項,不是唯一解)

- 整理你自己已經知道的東西

🟡 信但要驗證(30 秒即可)

- 具體人名、書名、引用 — 找得到原文嗎?

- 具體數字、百分比、版本號、日期

- 法條、條文編號

- 冷門程式套件、冷門 API 或函式名稱

- 時效性問題(「現在最新的是⋯⋯」)

- AI 推薦的特定店家、地點、營業資訊

🔴 不要只信 AI

- 法律建議 — 找律師,AI 只能幫你整理你想問什麼

- 醫療建議 — 找醫生,同上

- 投資建議 — 沒人替 AI 的答案負責,賠的是你

- 關於你自己人生的決定 — 職涯、感情、健康、財務,AI 沒有你的完整脈絡

- 公司機密外洩風險 — 預設會進訓練集

信任光譜的規則其實很簡單:AI 做不好的事你就別只依靠它,AI 做得好的事你就放手用。 三個地雷都是靠「停一下、查一下」就能解決;隱私那個則是靠一次性的設定調整。兩件事做對,AI 的風險降到可控。

今天就做一件事

找一段你最近跟 AI 的對話。挑一個具體事實 — 人名、書名、數字、條號 — 任何一個。花 30 秒 Google 查一下。

你會至少發現一件這兩種結果之一:

- AI 當時答對了 — 下次類似情境,你可以更有信心用它

- AI 當時悄悄瞎掰了一個細節 — 你差一點就帶著錯誤資訊做決定

不管是哪種,你都從「猜 AI 講得對不對」變成「知道 AI 講得對不對」。這個轉變比任何提示詞技巧都重要。

順便做一件事:花兩分鐘去你常用的那個 AI 的設定裡,確認訓練預設是開還是關。2025 年 10 月之後沒主動去看過的人,十之八九是開的。

這篇的一句話

AI 不是答案機器,是會瞎掰的協作工具。用得好的人把懷疑當習慣 — 信一半、查一半。

下一篇:你有 100 篇筆記,但從來沒發現第 3 篇跟第 87 篇其實在講同一件事。我們來聊怎麼讓 AI 幫你把自己的筆記串起來 — 不是整理,是旁徵博引。

這是「AI 怎麼問」系列的第七篇。上一篇:追問的藝術 — 第一個答案太淺怎麼辦。系列中的相關文章:在你動手做之前,先問:這東西存在嗎?、LLM 101 Part 5:Context Window。

常見問題

- 什麼是 AI 幻覺?

- AI 幻覺指的是 AI 用一樣自信的語氣,告訴你一件根本不存在的事 — 編造的人名、不存在的書、假的法條、偽造的判例。不是 AI 故意騙人,而是它在猜「長得像真實答案」的字串。Stanford AI Index 2026 量測 26 個主流模型,幻覺率從 22% 到 94% 都有,沒有一家真的解決。

- ChatGPT 會騙人嗎?

- 會 — 但不是惡意。ChatGPT、Claude、Gemini 都會在「具體事實 + 冷門主題」的交界處瞎掰,特別是人名、書名、引用、法條編號、特定日期。2025 年 5 月 Anthropic 自己的律師用 Claude 幫忙格式化法律引用,結果 Claude 編出一篇不存在的文章,法官直接把那段 declaration 砍掉。

- AI 的資料更新到什麼時候?

- 2026 年 4 月的時候,GPT-5 截到 2024 年 9 月、Claude Opus 4.6 的「可靠知識截止」是 2025 年 5 月、Gemini 3.1 截到 2025 年 1 月。不過現在大部分模型預設會即時上網搜尋,所以只要你問時效性問題(「現在最新的 iPhone」),它會主動查 — 只是你要確認搜尋功能有開。

- ChatGPT 聊天內容會被拿去訓練嗎?

- 預設會。ChatGPT 的消費者方案(Free / Plus / Pro)預設會把對話用來訓練模型 — 不手動到 Settings 關掉,你打的字就進訓練集。Anthropic 在 2025 年 8 月公告改規則,要求 Claude 消費者方案(Free / Pro / Max)用戶在 10 月 8 日前做一次強制選擇。Enterprise、Team、API 方案不受影響。要關:ChatGPT 到 Settings → Data Controls、Claude 到 Settings → Privacy。

- 為什麼 AI 聊到後面會忘記前面講的?

- 因為 AI 一次能讀的字有上限(可以想成它的書桌大小)。對話越長,早期的內容會被擠出書桌。當你發現 AI 忘記你設定的角色、忘記貼過的文件、或開始鬼打牆 — 書桌滿了。解法:把關鍵設定每次對話開頭重貼一次、長對話適時開新的。

- 哪些事情不該問 AI?

- 公司機密、個資、醫療、法律、投資這五類要小心。機密跟個資是隱私問題 — 預設會進訓練集。醫療、法律、投資是責任問題 — AI 的答案聽起來很專業但沒人替它負責,出事的是你。這些領域可以用 AI 整理你已經知道的知識,但不要用 AI 當諮詢來源。

- 怎麼判斷 AI 的答案是不是瞎掰?

- 三個訊號:(1) 具體名字 + 具體數字 — 人名、書名、ISBN、法條編號、百分比,越精確越要驗;(2) 冷門、在地、小眾的主題 — 訓練資料裡少見的東西 AI 最容易掰;(3) 語氣太自信 — 太篤定反而可疑。對策:把關鍵事實拿去 Google 搜一次,30 秒內能確認。